Ministro do STF defende punição a plataformas por omissão e chama de “mentes doentes” quem tolera racismo, homofobia e incitação à violência online

O ministro Alexandre de Moraes, do Supremo Tribunal Federal (STF), votou nesta quinta-feira (12) a favor da responsabilização civil das redes sociais por conteúdos ilícitos publicados por seus usuários. Com seu voto, a Corte já tem maioria para considerar inconstitucional o artigo 19 do Marco Civil da Internet, que hoje só permite a punição das plataformas após ordem judicial específica.

O julgamento foi suspenso e será retomado no dia 25, mas o placar parcial já indica um novo entendimento do STF sobre o papel das empresas de tecnologia. Sete ministros se posicionaram a favor da responsabilização das plataformas em casos como incentivo à violência, ataques à democracia, desinformação e crimes contra crianças e adolescentes.

O que está em jogo

A Corte julga a validade do artigo 19 da Lei 12.965/2014 — o Marco Civil da Internet — que atualmente impede a responsabilização das plataformas por conteúdos de terceiros, exceto quando há descumprimento de ordem judicial para retirada do material.

Os ministros analisam se essa regra é suficiente para proteger os direitos fundamentais diante de casos como a disseminação de discursos de ódio, incitação a crimes, ameaças a autoridades e promoção de atos antidemocráticos.

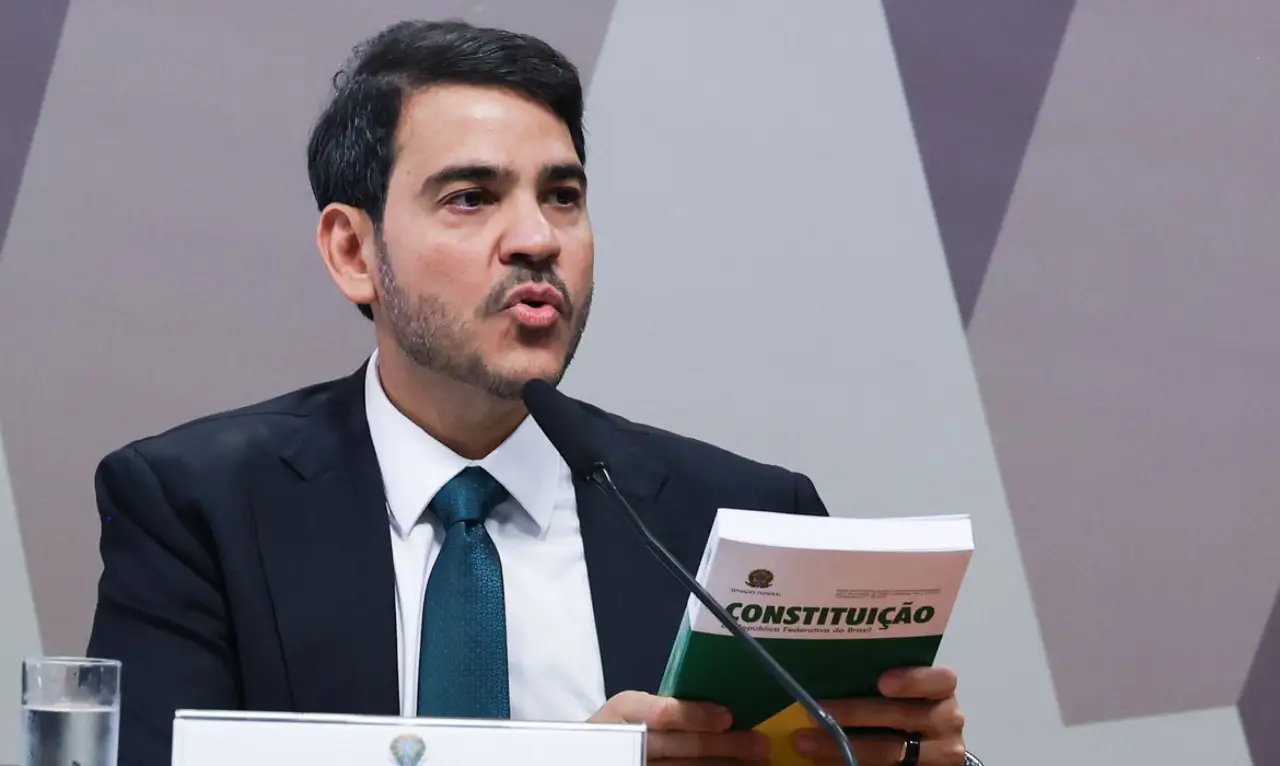

O voto de Alexandre de Moraes

Durante seu voto, Moraes exibiu no plenário imagens e mensagens racistas, homofóbicas e antissemitas que seguem ativas nas redes, apesar de denúncias. O ministro criticou duramente a omissão das plataformas:

“Somente uma mente doente e criminosa posta isso e outras mentes doentes e criminosas dão like. Somente mentes omissas não lutam para retirar isso das redes sociais. Isso não é liberdade de expressão, isso é crime.”

Moraes afirmou que grandes empresas de tecnologia mantêm um modelo de negócio “agressivo”, que ignora as leis brasileiras. “As plataformas não podem ser uma terra sem lei”, declarou.

8 de janeiro e falência da autorregulação

O ministro também usou como exemplo os ataques golpistas de 8 de janeiro de 2023, quando prédios dos Três Poderes foram invadidos em Brasília. Segundo ele, as redes sociais foram usadas para articular e transmitir ao vivo os atos:

“Destruíram, pediram intervenção militar e postavam no mesmo momento, e as redes sociais sem nenhuma autorregulamentação. A falência da autorregulamentação das redes sociais é que fez com que a gente tenha que julgar isso nestas sessões.”

Riscos a crianças e manipulação da verdade

Moraes criticou ainda os algoritmos que, segundo ele, expõem crianças e adolescentes a vídeos sobre ataques a escolas e automutilação. “A partir do momento em que uma criança ou adolescente consulta esse tema, é bombardeada por esses temas, incentivando a prática criminosa”, disse.

O ministro alertou também para a manipulação da verdade nas redes:

“As pessoas vêm sendo bombardeadas e submetidas a uma verdadeira lavagem cerebral. A verdade, a mentira, o que é falso vem sendo manipulado para ganhos econômicos e a obtenção do poder político.”

Como está o placar do julgamento

Com o voto de Moraes, são sete os ministros que consideram inconstitucional o artigo 19 do Marco Civil e defendem que as plataformas sejam responsabilizadas civilmente por omissão diante de conteúdos ilegais. Veja como votaram:

✅ A FAVOR DA RESPONSABILIZAÇÃO

Alexandre de Moraes

Gilmar Mendes – classificou o artigo como “ultrapassado”

Cristiano Zanin – disse que o artigo impõe ao cidadão o ônus de acionar a Justiça

Luiz Fux – defendeu retirada de conteúdos após notificação extrajudicial

Dias Toffoli – também votou pela responsabilização após denúncia da vítima

Luís Roberto Barroso – defendeu ordem judicial só para crimes contra a honra

Flávio Dino – (voto anterior já considerado na formação da maioria)

❌ CONTRA A RESPONSABILIZAÇÃO

André Mendonça – defendeu a manutenção do artigo 19, com foco na proteção à liberdade de expressão

O que falta decidir

Apesar da maioria formada, o STF ainda não definiu a tese jurídica que irá nortear futuras decisões sobre o tema. Esse texto final é essencial para esclarecer, por exemplo:

- Em que casos a remoção de conteúdo pode ocorrer sem ordem judicial

- Como deve ser feita a notificação pelas vítimas

- Qual o grau de responsabilidade das plataformas em situações de omissão

Os casos julgados

O STF analisa dois processos concretos:

Caso Facebook: julga se a empresa pode ser responsabilizada por danos morais após permitir a criação de um perfil falso, sem ordem judicial. Relatoria do ministro Dias Toffoli.

Caso Google: discute se a empresa tem o dever de fiscalizar e remover conteúdos ofensivos de sites que hospeda, também sem intervenção da Justiça. Relatoria do ministro Luiz Fux.